O Senhor das LLMs: O risco de confiar em promessas de domínio total das IA? | Caio Gomes

Alerta de risco máximo: apostar na sua carreira de analista de risco em um curso que promete transformar qualquer profissional em “construtor de soluções com IA” pode ser a pior decisão se o conteúdo não cumprir o que diz. Na prática, a maioria dos treinamentos de IA entrega apenas camada de superfície – prompts bonitos, slides coloridos e pouco mais. É uma onda sedutora de superficialidade que, para um profissional que lida com dados críticos e avaliações rigorosas, não apenas frustra, mas pode se tornar um verdadeiro passivo de carreira. A promessa de dominar as Large Language Models é tentadora, mas o verdadeiro perigo reside em aceitar a miragem do conhecimento raso como expertise, especialmente quando a sua função é identificar e mitigar ameaças complexas. A questão não é *se* você precisa de IA, mas *como* você a domina para realmente agregar valor e não apenas seguir tendências.

A busca por um guia sólido no universo das IAs é, sem dúvida, uma das dores mais latentes no mercado atual. Para um analista de risco, essa dor é amplificada: como avaliar os riscos de modelos que você não compreende a fundo? Como auditar sistemas autônomos se a sua experiência se limita a interface de usuário? O ponto central aqui é que não comprar (ou investir mal) em formação de IA agora significa ficar para trás, não apenas em termos de oportunidades de carreira, mas na própria capacidade de realizar seu trabalho com a profundidade necessária. O custo de não se adaptar é a obsolescência profissional, a dependência de consultores externos para tarefas que deveriam ser do seu domínio e, em última instância, a perda de relevância estratégica em sua organização. Imagine a seguinte situação: um novo modelo de IA é proposto para otimizar processos críticos da empresa. Se você não tem o conhecimento para mergulhar nos detalhes de como ele funciona, suas vulnerabilidades e potenciais vieses, como poderá exercer seu papel de analista de risco de forma eficaz? Isso se traduz em decisões subótimas e riscos não mitigados, um cenário que nenhum profissional sério deseja.

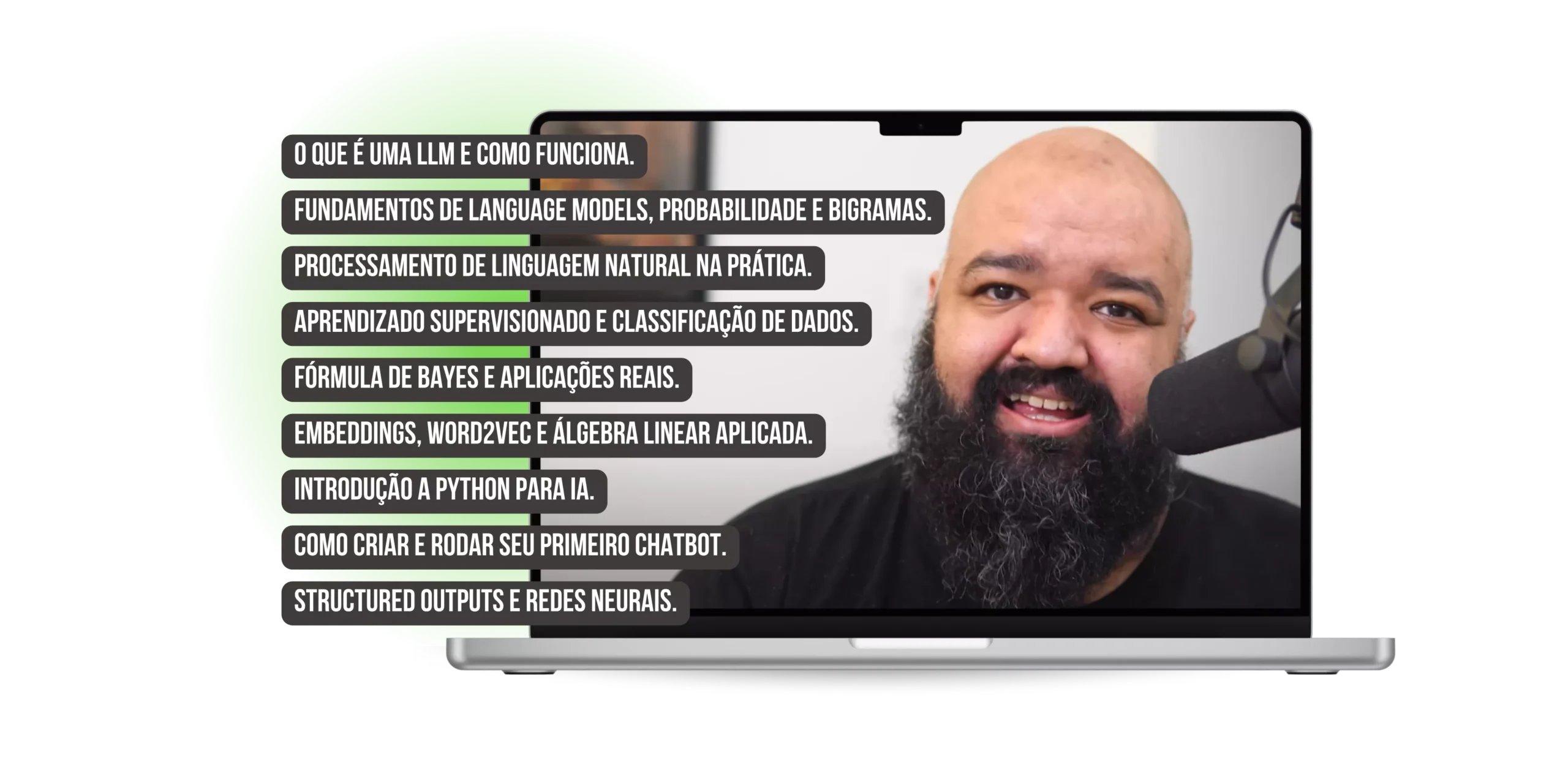

O “Senhor das LLMs” surge com uma promessa que soa como música aos ouvidos do profissional pragmático: formar seu público-alvo em construção prática de Large Language Models, sem truques de prompt, usando fundamentos científicos. O perigo real, como já apontado, reside em duas frentes que frequentemente minam a jornada do aluno: overpromising (prometer resultados que exigem tempo, recursos e maturidade que o aluno pode não ter) e under-delivery (conteúdo que, apesar da aparência robusta, não evolui com a velocidade das mudanças nos modelos ou peca na profundidade). A plataforma Hotmart oferece uma garantia de 7 dias sem burocracia, e isso é um ponto de partida. No entanto, diferente do que muitos prometem por aí, essa janela de sete dias, para um conteúdo de cunho técnico e prático como este, é irrisória para validar a eficácia. Sete dias são suficientes para saber se a interface funciona, não para internalizar os fundamentos e ver a aplicação real no seu contexto de risco, onde a curva de aprendizado é naturalmente mais íngreme. Além do mais, o curso exige dedicação contínua; ninguém garante que a agenda de um analista de risco permita prática semanal sem um planejamento robusto.

Mergulho Profundo: Desvendando a Essência Técnica do “Senhor das LLMs”

O ponto de verdade da oferta é inegável: o curso realmente ensina a montar chatbots e usar Retrieval-Augmented Generation (RAG) com embeddings. Não se trata apenas de teoria; há exercícios hands-on desde a primeira semana, o que reduz o risco de ficar apenas no nível de conhecimento superficial.

1. Retrieval-Augmented Generation (RAG): A Base da Autonomia em LLMs

A RAG é, sem dúvida, um dos pilares mais importantes para quem busca construir soluções de IA *confiáveis* e *controláveis*. Na prática, isso se traduz em um sistema onde a LLM não “alucina” informações, mas sim consulta uma base de dados externa e *confiável* (seja documentos internos da empresa, artigos científicos ou qualquer fonte validada) antes de gerar uma resposta. Para um analista de risco, isso é revolucionário: significa que você pode construir chatbots que não inventam fatos sobre políticas internas da empresa ou dados financeiros sensíveis. O curso, ao focar na implementação de RAG, não apenas ensina a técnica, mas fornece a ferramenta essencial para mitigar o risco de “alucinações” e garantir a auditabilidade das respostas geradas pela IA. Isso envolve entender como chunkar documentos de forma eficiente, escolher e integrar bancos de dados vetoriais (como o Pinecone ou o ChromaDB), e orquestrar o fluxo de dados entre sua fonte de verdade e a LLM. É aqui que a maioria das pessoas trava: a transição da teoria para a construção de um pipeline RAG robusto e escalável. O foco hands-on do “Senhor das LLMs” busca exatamente superar essa barreira, permitindo que você crie sistemas LLM com base em dados *seus*, controlados e verificáveis, uma necessidade crítica para qualquer ambiente de risco.

2. Embeddings: A Linguagem Secreta da Compreensão Semântica

Os embeddings são a espinha dorsal de como as LLMs compreendem e processam informações contextuais, e são absolutamente cruciais para a eficácia da RAG. Em termos técnicos, embeddings são representações numéricas (vetores) de palavras, frases ou até documentos inteiros em um espaço multidimensional, onde a distância entre esses vetores indica a similaridade semântica entre os itens. O que isso significa na prática? Que a IA não vê palavras como strings isoladas, mas como conceitos interligados. Ao aprofundar-se em embeddings, o curso capacita o aluno a selecionar os modelos de embedding mais adequados para seu caso de uso (por exemplo, embeddings otimizados para documentos jurídicos versus textos de marketing), a entender como eles são gerados e, mais importante, como eles podem ser utilizados para buscar informações relevantes de forma eficiente em sua base de conhecimento. A qualidade do seu sistema RAG, e consequentemente a confiabilidade das respostas da sua LLM, depende diretamente da sua capacidade de trabalhar e otimizar esses embeddings. Este nível de detalhe vai muito além de meros prompts e prepara o analista de risco para otimizar a relevância e a segurança das interações da IA com dados críticos.

Para quem O Senhor das LLMs NÃO é indicado

Apesar da proposta robusta, é fundamental ser honesto sobre as expectativas. Este curso NÃO é indicado para:

- Aqueles que buscam um atalho mágico: Se a sua expectativa é se tornar um “guru de IA” sem suar a camisa, ou encontrar uma solução plug-and-play para todos os seus problemas, este curso não é para você. Ele exige dedicação, prática e resiliência.

- Quem procura apenas certificação acadêmica: Embora o conhecimento adquirido seja valioso, este não é um programa de MBA ou uma certificação universitária formal. Seu valor reside na aplicação prática e não em um diploma para pendurar na parede.

- Usuários que querem apenas usar interfaces prontas: Se o seu objetivo é apenas aprender a digitar prompts mais eficazes em ferramentas como ChatGPT ou Bard, sem entender a “mecanografia” por trás, você encontrará o conteúdo excessivamente técnico e talvez frustrante.

- Profissionais sem qualquer base analítica ou estatística: Embora o curso comece do básico em termos de Python e conceitos de LLMs, uma mente analítica e uma familiaridade com raciocínio lógico-estatístico (comum em análises de risco) serão um diferencial e facilitarão a jornada.

- Quem não tem tempo para prática semanal consistente: A promessa de formação contínua com prática semanal não é um mero slogan. Sem essa dedicação, o conhecimento se diluirá, e o investimento de tempo e dinheiro perderá seu valor.

O Cenário Após 30 Dias: Transformando a Teoria em Ação

Imagine a seguinte situação: você dedicou algumas horas semanais, consistentemente, ao longo de um mês ao “Senhor das LLMs”. O que você pode esperar?

- Fim da Dependência de Tutoriais Rasos: Você terá superado a fase de apenas “testar prompts” e estará começando a compreender a arquitetura e os componentes que fazem uma LLM funcionar de verdade.

- Primeiros Projetos Hands-on: Você não estará apenas lendo sobre RAG; terá construído seus primeiros pipelines, talvez um chatbot simples que consulta seus próprios documentos. Isso significa passar de consumidor a construtor.

- Confiança Técnica: Suas conversas sobre IA na empresa não serão mais superficiais. Você terá a confiança para discutir termos como embeddings, chunking, vetores e LLMops de forma fundamentada, elevando seu status como um profissional que realmente entende a tecnologia.

- Identificação de Riscos Aprimorada: Com uma compreensão mais profunda da IA, sua capacidade de identificar vieses, vulnerabilidades e potenciais falhas em sistemas baseados em LLMs será exponencialmente maior, tornando-o um analista de risco mais proativo e estratégico.

- Conexão com a Comunidade: Você terá interagido com uma comunidade ativa, trocando ideias e aprendizados, o que acelera ainda mais sua curva de desenvolvimento e abre portas para novas perspectivas e colaborações.

Entretanto, a falha potencial está na escala de apoio. Embora haja respostas rápidas via Hotmart e comunidade ativa, a ausência de suporte técnico *aprofundado* um a um pode fazer um usuário travar em questões críticas de segurança de modelo ou viés – problemas que, como analista de risco, são seu foco diário. Isso significa que, em certos momentos, você precisará exercitar sua autonomia e buscar soluções ou aprofundamentos por conta própria, utilizando a comunidade como um trampolim e não como um suporte técnico exclusivo.

A estrutura do curso, com seu preço de R$49,90/mês e uma garantia de 7 dias, posiciona-o como uma oferta de alto custo-benefício. A duração de “formação contínua com prática semanal” reforça o compromisso com o aprendizado a longo prazo, e o nível intermediário exige um esforço consciente do aluno. Os prós – preço acessível, conteúdo prático desde a primeira semana, instrutor com experiência real (Caio Gomes, conhecido pelo canal “O Físico Turista”, onde explica casos reais de implementação de IA em grandes empresas), foco em soluções próprias, e networking ativo – são significativos. Os contras – a exigência de dedicação contínua e o fato de não substituir um MBA completo em IA – precisam ser considerados. A comunidade do curso costuma compartilhar projetos publicados, o que aumenta a transparência e serve como um valioso portfólio para os alunos. Ainda assim, o que ninguém te avisa é que *nenhum curso online substitui experiência prática em projetos corporativos críticos*. Você ainda precisará aplicar o aprendizado em ambientes controlados antes de levar ao cliente, mas o “Senhor das LLMs” te dá a base para iniciar esses projetos com confiança e autonomia.

FAQ de Objeções: Desmistificando Suas Dúvidas Mais Comuns

1. “O curso é muito técnico para mim? Preciso ser um programador expert?”

O curso é classificado como de nível intermediário, o que significa que ele presume alguma familiaridade com raciocínio lógico e, idealmente, uma base mínima em programação (Python é o ideal). Ele não te pede para ser um programador expert, mas sim para ter a mente aberta para aprender a *construir*. O instrutor parte dos fundamentos, mas o ritmo é de quem busca aplicação, não de quem está começando do zero absoluto em lógica de programação. Se você tem uma base analítica sólida e está disposto a colocar a mão na massa com código, você vai se adaptar.

2. “Vou conseguir aplicar isso no meu contexto de trabalho real como analista de risco?”

Absolutamente. O foco em RAG e embeddings é precisamente o que permite construir soluções de IA que são auditáveis, controláveis e menos propensas a vieses e “alucinações”. Para um analista de risco, isso é ouro. Você aprenderá a construir sistemas que podem, por exemplo, analisar grandes volumes de documentos regulatórios, identificar cláusulas de risco ou até mesmo simular cenários com dados internos de forma controlada, reduzindo a dependência de caixas-pretas e aumentando a governança sobre a IA. Este é o caminho para deixar de ser reativo e tornar-se proativo na gestão de riscos de IA.

3. “A garantia de 7 dias é realmente suficiente para saber se vale a pena?”

Como discutimos, sete dias são um ponto de partida para sentir a didática e a plataforma, mas não para dominar o conteúdo. A verdadeira validação virá com a sua dedicação contínua ao longo das semanas. O valor de R$49,90/mês, no entanto, minimiza o risco financeiro de uma “aposta” de longo prazo. Pense nisso como uma assinatura de academia: você não espera ver resultados em 7 dias, mas o custo baixo por mês permite que você invista na sua “saúde de carreira” com flexibilidade e sem um grande desembolso inicial.

4. “Isso vai me tornar um ‘especialista’ em IA do dia para a noite?”

Não, e qualquer curso que prometa isso está sendo desonesto. O “Senhor das LLMs” oferece uma *formação*, um caminho contínuo para construir competências. A expertise real vem com a prática constante, a aplicação em projetos do mundo real e a atualização contínua, dada a velocidade do campo da IA. O curso fornece as ferramentas e o mapa, mas a jornada para a maestria é sua. Considere-o um acelerador e um guia fundamental para essa jornada, não um destino final instantâneo.

Se a sua meta é reduzir a dependência de tutoriais rasos e ganhar autonomia para construir pipelines de IA, o investimento de R$49,90 por mês tem um custo-benefício atrativo quando comparado a bootcamps que cobram até R$200k. Mas, se o seu objetivo imediato é obter certificação acadêmica ou um atalho rápido para deploy de chatbots sem aprofundamento, o risco de desapontamento aumenta significativamente. O valor aqui não é o papel, mas a capacidade de *fazer*. Para uma descrição detalhada do programa e depoimentos de alunos que já concluíram a formação, que podem ajudar a checar a aderência do conteúdo ao seu plano de desenvolvimento, você pode visitar: O Senhor das LLMs – Detalhes e Depoimentos.

Veredito de risco final: Para um analista de risco que já possui base em estatística, uma mente analítica e o desejo genuíno de evoluir para a construção autônoma de soluções de IA, o “Senhor das LLMs” de Caio Gomes apresenta um risco aceitável e um potencial de retorno significativo. O preço acessível, o conteúdo prático e hands-on desde o início, a expertise do instrutor e a comunidade ativa são fatores mitigadores robustos. Contudo, o risco não é zero: exige tempo dedicado e não substitui a insubstituível experiência em projetos críticos de grande escala – algo que você construirá *após* solidificar sua base com este curso. Se você tem disponibilidade para praticar semanalmente, está disposto a ir além do superficial e busca autonomia real para entender, construir e, consequentemente, mitigar os riscos das IAs, a aposta neste programa vale a pena e pode ser um divisor de águas em sua carreira. Caso contrário, se o tempo é um luxo que você não possui ou sua busca é por um atalho sem esforço profundo, procure alternativas mais estruturadas ou programas de certificação reconhecida que se alinhem melhor com suas expectativas e disponibilidade antes de investir seu tempo e recursos aqui.